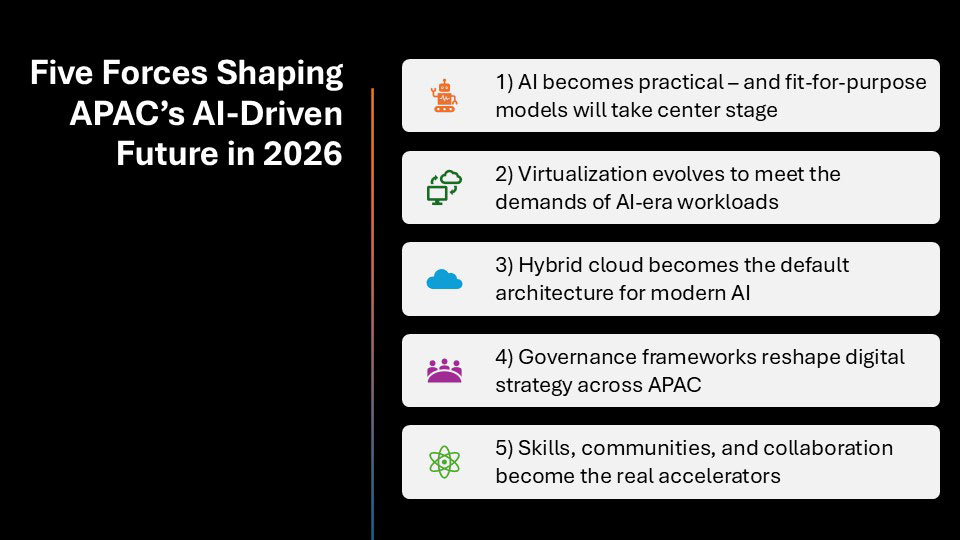

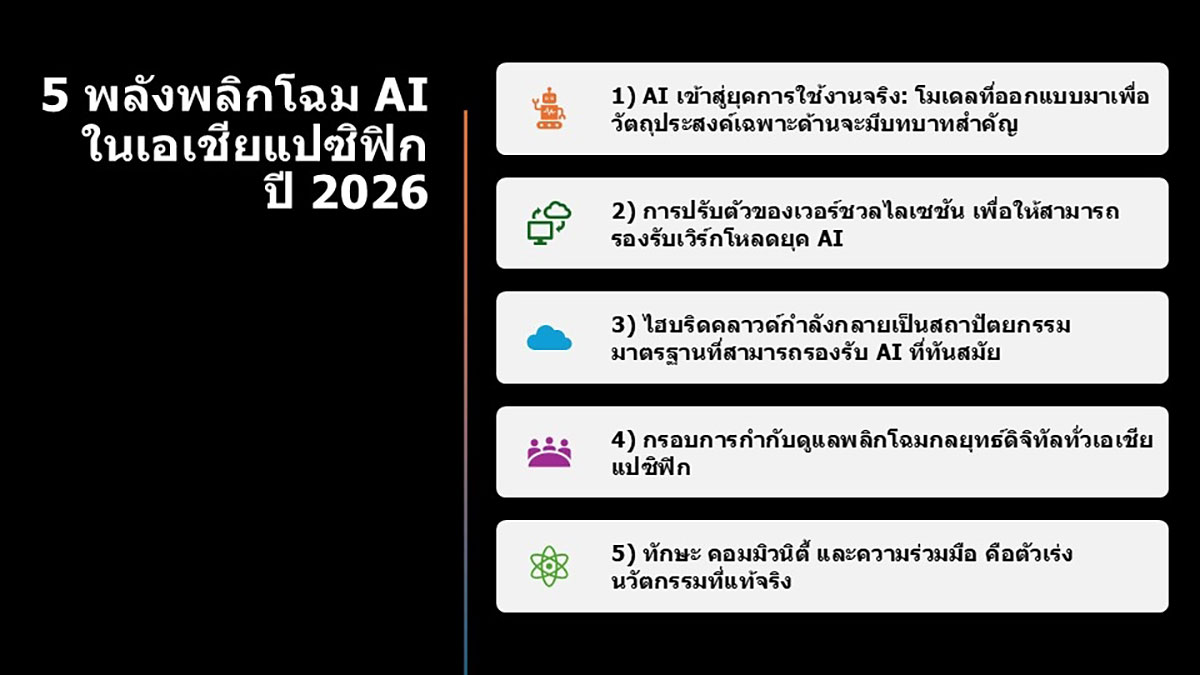

Five Forces Shaping APAC’s AI-Driven Future in 2026

Article by Supannee Amnajmongkol Thailand Country Manager, Red Hat

Organizations in Asia-Pacific are entering the new year with a sharper focus than ever before, as they shift from trying emerging technologies to transforming with them. Leaders have moved past experimentation and are now focused on how to operationalize them responsibly, at scale, and with measurable returns – embedding AI into the core of their digital platforms.

The AI era is moving toward specialization and organizations want systems that are tuned to their industries, data, and operational realities. They also want the freedom to run these workloads wherever it makes most sense: be it on-premise, in the cloud, or at the edge. This combination of specialized intelligence and architectural flexibility is what I believe will shape the defining trends of 2026.

1) AI becomes practical – and fit-for-purpose models will take center stage

If 2023 to 2025 were defined by the excitement of generative AI, 2026 will be defined by its practicality. In the last two years, we have gone from proving AI’s potential to proving its value in meeting specific business needs.

A recent IDC study found that 70% of Asia-Pacific organizations expect agentic AI to disrupt their business models within the next 18 months¹. Enterprises are beginning to realize that the future of AI lies not in models that attempt to do everything, but in specialized, right-sized, and explainable systems designed for specific industries and workflows. This shift aligns with another IDC prediction: by 2027, 40% of organizations will use custom silicon, including ARM processors or AI/ML-specific chips, to meet rising demands for performance optimization, cost efficiency, and specialized computing².

In financial services in particular, fit-for-purpose AI can help automate complex, high-volume processes such as client onboarding, transaction monitoring, and fraud analysis — areas that remain heavily manual today. For institutions under mounting regulatory and operational pressure, specialized AI systems offer a clearer path to improving accuracy, reducing cost, and strengthening risk management.

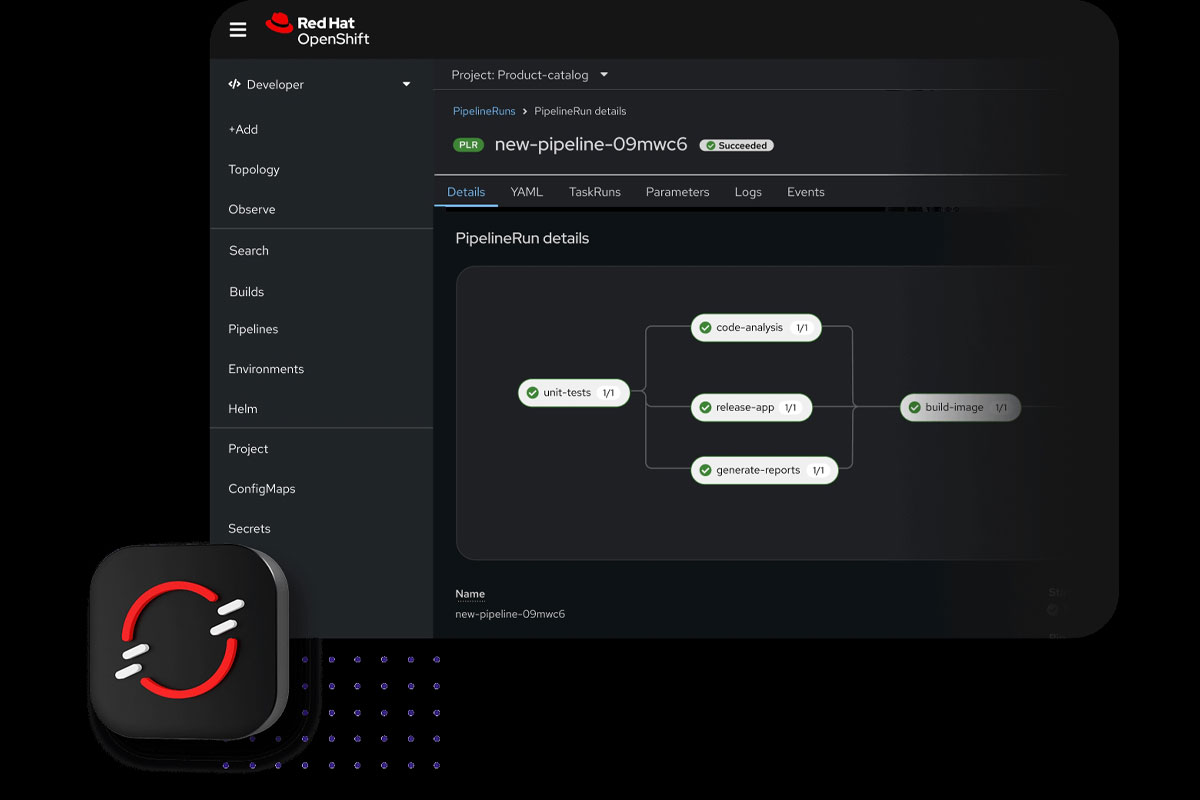

In alignment with the Thailand National AI Strategy and Action Plan (2022-2027), second phase (2024-2027), which identifies the financial sector as a key target industry for AI adoption, Thai commercial banks are increasingly leveraging AI for credit scoring. By analyzing data for retail customers and those without fixed incomes, these banks are significantly broadening financial inclusion and boosting the country’s economic potential. Additionally, the government’s Cloud First Policy and the Bank of Thailand’s (BOT) regulatory framework are pushing organizations toward cloud-native services and containerization. These tools are key to increasing data flexibility and supporting efficient AI processing.

Business leaders will need to rethink their infrastructure strategies to support more diverse and demanding AI workloads. We will see growing interest in unified inference layers that can support a wide range of AI models without compromising performance and cost efficiency. At the same time, there is strong momentum around connecting enterprise application platforms with cloud-based AI accelerators, giving organizations a more seamless way to operationalize AI at scale. By pairing flexible platforms with specialized computing, enterprises can accelerate the shift from pilots to producing measurable business impact.

2) Virtualization evolves to meet the demands of AI-era workloads

AI is reshaping how enterprises think about infrastructure. Traditional virtualization approaches, built for predictable and uniform workloads, are now being stretched by the needs of modern AI — which demand higher performance, lower latency, and far more flexibility.

In 2026, enterprises will increasingly adopt virtualization strategies that bring together virtual machines, containers, and specialized compute under a single operational model. This helps platform teams modernize at their own pace while supporting both existing applications and new AI-driven workloads. The result is an infrastructure foundation that is flexible enough to run traditional applications and intelligent systems side by side — without sacrificing governance or control.

3) Hybrid cloud becomes the default architecture for modern AI

As AI models increasingly rely on real-time data, distributed systems, and specialized computing resources, enterprises need architectures that allow them to run workloads as close to their data as possible, while still maintaining scalability and resilience.

The demands of AI require the hybrid cloud. And in 2026, hybrid cloud will solidify its position as the standard operating model for intelligent enterprise systems.

Organizations will prioritize platforms that help them maintain control over sensitive workloads on-premises, scale using public cloud capabilities, and bring intelligence closer to where data is generated at the edge.

For financial institutions, the hybrid cloud model is especially critical. Sensitive and regulated workloads must remain on-premises, while AI-driven analytics often require the elasticity and specialized compute of public cloud environments. This balance is becoming foundational for FSI firms modernizing their risk, compliance, and customer systems.

This reflects a broader industry truth: there will not be one place where AI runs. Enterprises that design environments capable of running AI anywhere will be best positioned to capture its value.

4) Governance frameworks reshape digital strategy across APAC

As AI adoption accelerates, governance will become one of the most defining forces shaping digital strategy in Asia-Pacific. Stronger governance frameworks will influence how AI is adopted across the region. Organizations want systems with greater security, transparency, and alignment with local regulations — and increasingly expect their technology platforms to support these requirements across hybrid and multi-cloud environments.

Southeast Asia is striving to balance innovation and regulation. Similarly, Thai authorities are promoting ethical AI use to minimize risks. Key to this effort is the ETDA’s AI Governance Center (AIGC), which provides guidelines for the private and financial sectors. This framework ensures compliance with local laws like the PDPA and meets international best practices in technical, legal, and practical applications.

Financial services will play an outsized role in shaping these standards. With stringent requirements around auditability, traceability, and model behavior, FSI organizations are already setting the benchmark for responsible AI adoption — creating patterns that other industries are likely to follow.

These guardrails are not slowing innovation — they are enabling it. In 2026, enterprises will increasingly prioritize AI systems that can be audited, monitored, and governed across hybrid environments, ensuring that decisions remain traceable and models behave as expected. This governance shift will also influence architectural choices, vendor selection, and skill priorities. Enterprises will seek open, trustworthy solutions that allow them to examine how models are built, how data is used, and how decisions are made. In regulated industries like financial services, these capabilities will become non-negotiable.

5) Skills, communities, and collaboration become the real accelerators

No transformation happens without people. The demand for cloud-native, AI, and cybersecurity talent continues to outpace supply across Asia-Pacific, and in 2026, the gap will only widen unless organizations invest in a skills-first approach to build, operate, and optimize modern digital systems.

Thailand aims to develop at least 30,000 AI professionals by 2027 through AI reskilling and upskilling initiatives designed to bridge the digital talent gap. One of the examples is the public-private partnership between MDES and MHESI, which established the GDCC AI Marketplace. Serving as a central hub for accessible AI tools and services for the Thai people, the marketplace has launched various applications, including AI, security, and data analytics platforms, etc.

Open source communities will play a central role in this shift. They provide shared knowledge, transparency, and a global ecosystem rooted in collaboration. Tools and frameworks are also made available to everyone, instead of just a few. As more enterprises contribute back to these communities – by building on ideas quickly and responsibly – Asia-Pacific will strengthen its position in digital innovation, not just as a consumer but increasingly as a creator.

Thailand itself as well has developed over twenty homegrown AI solutions. These range from comprehensive AI services and Thai-language robotics to AI Energy platforms, DevOps services, and specialized AI applications for agriculture and precision medical imaging.

The right model, in the right environment, on the right architecture will define the next era of enterprise AI. The success of agentic AI will hinge not only on powerful models, but on the infrastructure, governance, and skills that support them. In 2026, openness, flexibility, and collaboration will remain the principles that help organizations move from potential to real, measurable outcomes. With no single model suited to every enterprise context, open source will continue to underpin the freedom and innovation needed to build what comes next.