AI in telco – the catalyst for scaling digital business

Article by Beatriz Ortega, Hybrid cloud specialist and business development lead, Telecoms, Red Hat

If you aren’t currently architecting for AI, you are part of a rapidly dwindling minority. By 2026, the pivot is no longer optional: AI has moved from a peripheral tool to the primary engine for transforming digital businesses, slashing operational complexity and driving revenue growth.

The shift to agentic AI and zero-touch operations

The industry is moving beyond passive chatbots toward agentic AI. While traditional AI provides insights, generative AI makes suggestions, now agentic AI provides action. In a practical telco context, this means autonomous agents capable of navigating complex workflows: identifying network bottlenecks, cross-referencing customer SLAs, and triggering resource re-allocations via TM Forum open APIs. This transition enables the zero-touch operations essential for efficiency, reliability and scale of 5G and edge networks.

A major shortcoming of early adoptions is the creation of AI islands – disconnected models that solve niche problems but cannot communicate with each other. Red Hat advocates for a more modular and interconnected strategy using open standards and a mesh architecture, where specialized micro-agents communicate through universal protocols like the model context protocol (MCP) and agent-to-agent (A2A) frameworks.

Micro-agents are purpose-built, autonomous solutions designed to be interconnected. When linked together, these agents create a collective intelligence. A good example is customer-service insights that can inform network optimization processes in real-time, ensuring every AI organ works toward a unified business goal.

However, the primary barrier to connected intelligence is data fragmentation. To bridge that gap between intelligence and action, the MCP provides an open source framework that enables standardized access to other systems and external data. MCP ensures an AI agent is no longer an isolated brain but a functional limb capable of interacting across and with the entire operational ecosystem.

The Red Hat advantage: any model, any accelerator, anywhere

Red Hat AI provides an open platform that simplifies the move from experimentation to production-grade AI. It comprises:

- Red Hat Enterprise Linux AI: Provides a sovereign foundation to tune open source models (like Granite) with proprietary data, ensuring you own your intelligence without vendor lock-in.

- Red Hat OpenShift AI: A unified operations engine managing the AI lifecycle with mission-critical rigor. It integrates LlamaStack as the standardized, Kubernetes-native orchestration layer for building agentic AI workflows.

- Red Hat AI Inference Server: Hardened with vLLM, this server enables high-performance, low-latency execution on any processors, like CPUs or GPUs. By supporting diverse silicon (NVIDIA, AMD, Intel), Red Hat maintains flexibility so your engine is not locked into a specific hardware vendor and utilizes the best and most cost efficient hardware for the job.

Innovations like llm-d, the strategist and orchestrator for vLLM, make this even more powerful. This Kubernetes-native framework, founded by CoreWeave, Google Cloud, IBM Research and NVIDIA and joined by AMD, Cisco, Hugging Face, Intel, Lambda and Mistral AI, unlocks even greater efficiency in deployments of large-scale distributed inference.

In 2026, the Red Hat and NVIDIA collaboration has advanced from pure hardware compatibility to a unified software-defined architecture. This collaboration delivers rack-scale AI systems that industrialize open source-based AI factories, capable of running advanced reasoning and agentic workloads at gigabit scale.

Four AI use cases delivering immediate telco value

- Autonomous networks: from automation to autonomy

The vision of fully autonomous networks is now an architectural reality. Autonomous networks utilize AI for closed-loop systems that observe, reason, and adapt.

While the journey to fully autonomous networks consists of multiple integrated milestones, the following two applications illustrate practical first steps with immediate return on your investment:

- Self-healing: When anomalies occur, agentic AI performs multi-domain root cause analysis (RCA). Using Event-Driven Ansible as part of Red Hat Ansible Automation Platform, the network can autonomously trigger remediation, like re-routing traffic or antenna tilt adjustment, in milliseconds. If a remediation is not predefined, Red Hat Ansible Lightspeed supports the creation of new playbooks on the fly.

- Predictive zero-touch scaling: By cross-referencing social event feeds (transit, public gatherings) with mobility data via MCP, AI agents on OpenShift AI proactively scale CNFs across the edge. This surges capacity precisely where needed and releases it back once demand subsides, aligning performance with ESG goals.

- Intent-driven energy and cost reduction

Instead of rigid sleep cycles, operators define a high-level intent: “minimize carbon footprint while maintaining 99.9% availability.”

Specialized AI agents can monitor real-time density. If a sector is underutilized, the AI enabled automation autonomously triggers massive MIMO sleep modes, significantly reducing overall energy consumption.

This simple use case balances performance with sustainability, reducing OpEx and carbon footprint without compromising the customer experience.

- Hyper-personalized customer experience

AI transforms your customer support team from a reactive to proactive operation.

Predictive AI identifies degrading signals at a subscriber’s location and initiates a self-healing protocol (e.g., cell handover optimization) before the subscriber notices a problem.

Generative AI provides front-line agents, humans and chatbots, with synthesized logs and context, turning service providers into experience providers.

- Real-time vendor management & SLA governance

In multi-vendor environments, AI acts as a digital auditor. By ingesting cross-domain telemetry via MCP, an AI agent performs objective RCAs to pinpoint vendor performance issues. It can autonomously trigger notifications or calculate contractual credits, creating a more informed, high-accountability ecosystem.

Navigating the three core challenges of AI adoption

While the symptoms of AI friction are universal, such as slow deployment or high costs, the specific challenges in telco AI adoption vary significantly depending on a company’s architectural maturity and strategic priorities.

Adopting AI within a telecommunications framework is less about the intelligence of the model and more about the readiness, flexibility and transparency of the architecture. From a Red Hat perspective, the transition from experimental pilots to production-scale agentic AI faces three primary hurdles: data fragmentation, operational complexity, and the black box of proprietary lock-in.

The challenge of data silos and contextual awareness: The most significant blocker to AI ROI is the lack of contextual awareness. AI models often struggle with hallucinations because they lack access to real-time, high-fidelity telco data – which is usually trapped in fragmented silos spanning network logs, customer records, and multi-vendor KPIs.

As mentioned, MCP is an open source framework that allows AI agents to interface with external data and legacy tools, enabling full architectural interoperability.

Operational complexity makes pilots unable to scale: Many service providers fail to scale because they attempt monolithic AI overhauls that are too complex to manage. Without a consistent environment, moving a model from a data scientist’s laptop to a cell tower at the edge creates immense operational friction and risk of failure.

Red Hat AI provides an AI factory foundation for the entire AI model and application lifecycle. By treating AI workloads like containerized microservices, service providers can use the same DevOps rigor they use for their core network functions integrated with MLOps tools for AI lifecycle management. We advocate for starting with micro-AI agents – small, purpose-built solutions for specific tasks – which can later be interconnected into a broader, intelligent mesh.

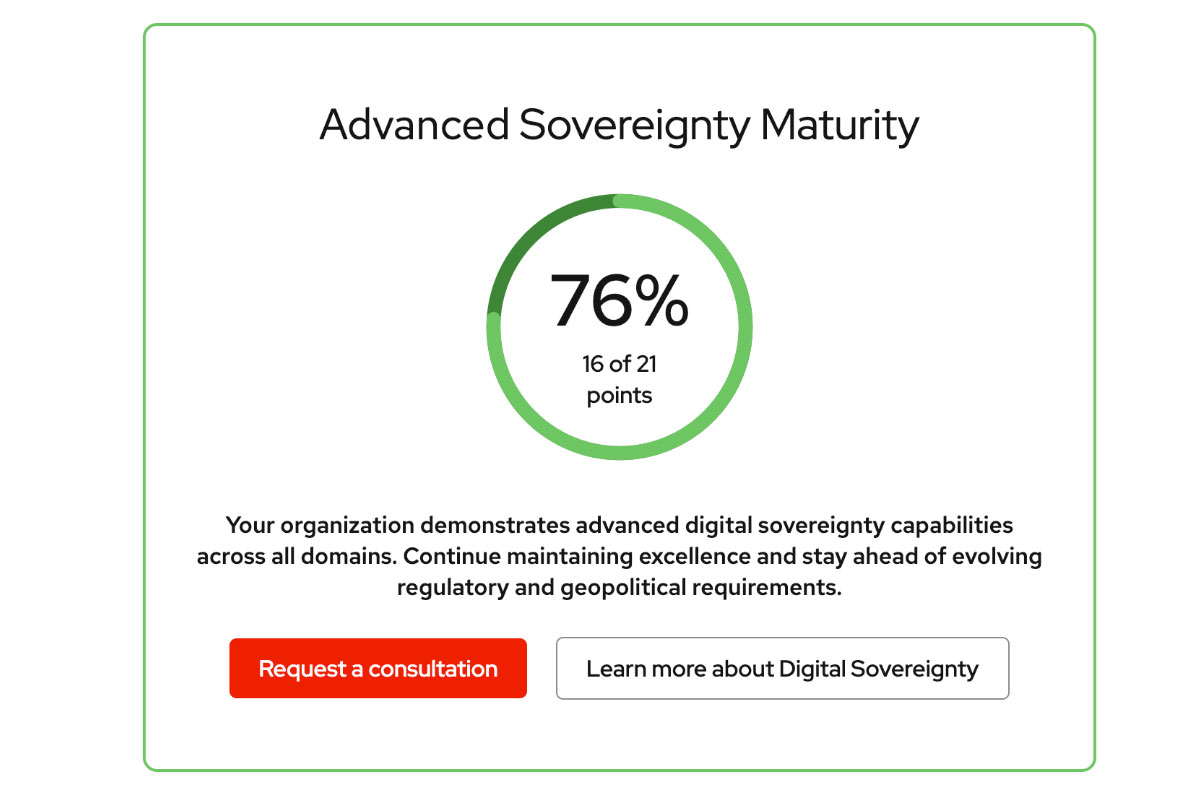

Vendor lock-in and digital sovereignty risks: relying on black box proprietary AI services poses a massive risk to long-term flexibility and data sovereignty. If your core network intelligence lives entirely within a single provider’s cloud, you run the risk of losing control over your costs and your data sovereignty.

Red Hat’s focus on enabling any model, any accelerator, any cloud is the antidote to lock-in. By providing integration with a large choice of open source models, service providers can tune models of their choice with their own data on their own infrastructure. This gives them control over the model weights and the underlying data, while vLLM ensures the inference remains high-performance across any hardware. And with Red Hat OpenShift service providers are able to manage end-to-end AI and application life cycles across any environment.