Alibaba Cloud Drives a More Sustainable, Efficient and Intelligent Olympic Experience at Milano Cortina 2026

- Transportation Management System mobilizes over 80,000 Olympic stakeholders

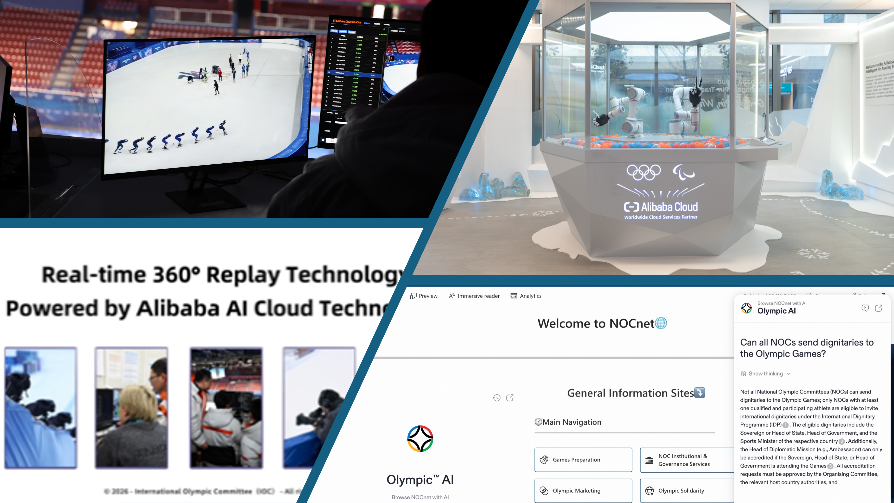

- Media Rights Holders had access to 4,198 video highlights produced by Alibaba Cloud’s Real-Time 360º Replay systems

- Qwen models power first use of LLM Technologies supporting fan engagement and Olympics ecosystem

In a ongoing effort to redefine the digital landscape of the Olympic Movement, Alibaba Group, the Worldwide TOP Partner of the International Olympic Committee (IOC), has supported the Olympic and Paralympic Winter Games Milano Cortina 2026 (Milano Cortina 2026) in becoming the most intelligent Games in Olympic history.

Through a suite of advanced cloud and AI-driven solutions, Alibaba Cloud, the digital technology and intelligence backbone of Alibaba Group, is empowering the IOC and the Milano Cortina local organizing committee to monitor and manage energy consumption, optimize transportation systems, enhance broadcasting operations, and foster IOC’s first use of LLM technology.

Kirsty Coventry, International Olympic Committee President, said: “Every Olympic Games leaves its own mark in terms of technological innovation. With Alibaba’s Cloud technologies and Qwen models, these Games have set a new benchmark for intelligence and creativity.”

Dr. Feifei Li, Senior Vice President of Alibaba Cloud Intelligence Group, President of International Business, said: “Milano Cortina 2026 marks a milestone with the first use of LLM technologies in the Olympic history powered by Alibaba’s Qwen models. Our cloud and AI-powered systems that supported Milano Cortina 2026 demonstrate our dedication to enabling smarter operations, deeper engagement, and new possibilities for the Olympic Movement.”

Sustainability successes

Alibaba Cloud’s AI-driven sustainability solutions and energy-efficient cloud infrastructure enabled Milano Cortina 2026 to effectively measure and analyze carbon emissions. This move sets a scalable model for future host cities to deliver more energy-efficient and carbon-saving Olympic Games.

Key systems developed and deployed include:

- Enhanced Energy Data Management Systemdeployed across all competition venues, allowing the Milano Cortina 2026 Organizing Committee and the IOC to monitor and analyse energy consumption and carbon emissions in real time. The IOC is also testing the Intelligent chatbot powered by Alibaba’s Qwen large language models, which enables staff to access both historical and real-time insights on electricity usage and power demand contingency.

- Energy Issue Tracking Systemthat digitalise workflows for identifying, escalating, and resolving energy anomalies, ensuring rapid responses and improving operational efficiency.

- Codeveloped Sustainability Platformthat allows organisers to assess the full lifecycle footprint of Milano Cortina 2026, with a dedicated focus on generating long-term benefits for local communities.

Accelerating efficiency

Drawing on iconic, world-class winter sports venues, Milano Cortina 2026 unfolded across more than 22,000 square kilometres of northern Italy’s alpine mountains and historic cities. Milano Cortina 2026 marked the Winter Games with the widest geographical spread in Olympic history. Spanning tens of thousands of square kilometres across the Alps, the event utilized Alibaba Cloud’s systems to assist game judging, coordinate logistics and operations, ensuring the Games ran smoothly and efficiently.

The IOC has worked with Alibaba Cloud to debut a sophisticated Video Adjudication system for the Milano Cortina 2026. Built on Alibaba Cloud’s low-latency livestreaming technology, this solution has been integrated into the core competition infrastructure to improve officiating precision. By synchronized management of multi-signal video feeds, the system assists referees in identifying fouls and provides instant arbitration playback to resolve scoring disputes. The technology has been deployed in Freestyle Skiing and Snowboard Slopestyle events to ensure accuracy for the judging panel.

The Transportation Management System (TMS), built on Alibaba Cloud, seamlessly connected venues across vast distances and delivered precise mobility assurance for millions of Olympic stakeholders including IOC staff, athletes, volunteers, media and key personnel. Through the Milano Cortina 2026 Transport App and related system services, athletes and Olympic staff accessed personalised journey planning and real-time updates via connected official transport services. Throughout the Games, the app has mobilized over 80,000 individuals.

Other operational service applications — from e-voucher system supplying meals to tens of thousands of Olympic stakeholders, to meteorological service portal providing real-time weather information for Milano Cortina Organizing Committee to ensure the safety of outdoor competitions — also ran on Alibaba Cloud’s stable and resilient infrastructure.

In addition, the cloud provider’s Apsara Video technology has powered cloud-based live streaming and broadcasting for Milano Cortina 2026, enabling global media access to press conferences, IOC daily briefings, and post-competition athlete interviews in real time. This fully cloud-hosted Game Video Content Distribution service supported journalists with seamless video processing, editing, live and on-demand distribution, and secure download capabilities — all delivered through Alibaba Cloud’s resilient infrastructure.

An AI makeover on Olympic Tradition

Alibaba Cloud introduced an “Intelligent Pin Trading Station” in the Milano Olympic Village, adding an AI-enabled twist to one of the Games’ most cherished traditions.

Powered by Alibaba’s Qwen model, the station combines embodied devices with an AI system capable of understanding both language and visuals. Athletes place a pin into a capsule and interact naturally using voice and gestures. The AI interprets commands in real-time and guides a robotic arm to select a pin left by a previous participant. The result is a playful exchange that connects athletes through a tradition they already love, while broadening the range of people, countries, and stories represented in each trade.

The Intelligent Pin Trading Station demonstrates how cloud-based AI can support new forms of engagement—creating small moments of delight that encourage connection and discovery. Throughout the Games, Alibaba Cloud Intelligent Pin Station facilitated over 8,000 pin exchanges among athletes.

Intelligent by design

At Milano Cortina 2026, Alibaba Cloud’s Qwen large language models powered the first use of LLM technologies in Olympic history, advancing the IOC’s digital transformation and delivering a smarter, more connected Games. Qwen supported a range of applications, from enhancing global fan engagement to streamlining information management and operations across the Olympic ecosystem.

Key platforms — including the Olympic AI Assistant, NOC AI Assistant, and the Sports AI Platform — used Alibaba Cloud’s infrastructure to enable multilingual fan interactions, intelligent content search, and largescale media management. Collectively, these AI-driven systems set new benchmarks for accessibility, efficiency, and intelligence within the Olympic environment.

Broadcasting redefined

In broadcasting, the OBS Live Cloud Platform, powered by Alibaba Cloud, transformed how the Olympic Games were produced and delivered. Replacing traditional satellite operations, the cloud-based platform provided flexible, scalable, and high-quality content distribution of 442 live video feeds for 42 broadcasters worldwide.

Cloud broadcasting significantly reduces the physical footprint. Milano Cortina 2026’s International Broadcasting Centre was 25% smaller than Beijing 2022 and 30% smaller than Pyeongchang 2018.

Complementing this were advanced AI solutions such as the Real-Time 360º Replay systems and the Qwen-powered Automatic Media Description System (AMD). Together, these innovations modernised live production workflows, improved media turnaround speed, and set a new standard for intelligent broadcasting in the Olympic Movement. Throughout the Milano Cortina 2026, AMD has processed livestream signals of 391 competition sessions; meanwhile, Media Rights Holders (MRHs) had access to 4,198 video highlights of exciting moments from the competitions, all captured and produced by Alibaba Cloud’s Real-Time 360º Replay systems.

Through its longstanding collaboration with the IOC, Alibaba Cloud continues to transform the Olympic Games, making them more sustainable, efficient, and intelligent for all participants and audiences worldwide.